깊이 보기

[2025.03~04]

#3 ‘딥페이크’ 성범죄에 노출된 여성

그리고 ‘잊힐 권리’를 위해 지우는 사람들

2020년 떠들썩했던 ‘N번방’ 사태 이후 5년이 지났지만, 디지털 성범죄는 더욱 교묘해진 수법으로 제2, 3의 N번방을 통해 진행 중이다. 기존에는 ‘디지털 성범죄 피해’라고 하면 동의없이 찍힌 불법 영상물을 떠올렸지만, 최근에는 딥페이크와 생성형 AI의 기술이 발달하면서 합성 영상물로 범위가 확대되고 있다. 언제든지 자신의 얼굴이 합성·편집된 ‘가짜 영상’이 온라인 공간을 떠돌지 모른다는 불안감까지 가중된 것이다.

이때 피해자 대부분은 여성이며, 이중 10~20대가 절반을 차지한 것으로 나타났다. 디지털 기기나 온라인 플랫폼 이용이 잦은 연령층에서 피해가 집중됐다는 점은, 익숙하고 친밀한 온라인 공간이 다른 한편으로는 성 착취 공간이 될 수 있다는 것을 보여준다.

무엇보다 AI(인공지능)기술이 발달하고 범용화될수록, 딥페이크 성범죄에 노출되는 대상은 제한이 없다. 일상생활을 공유한 소셜미디어(SNS), 졸업앨범, 사원증 등 노출된 사진으로 얼마든지 딥페이크 영상물을 만들 수 있기 때문에 ‘누구라도’ 피해자가 될 수 있다.

“시키는 대로 하지 않으면 알몸사진 (만들어) 유포하겠다.”

이처럼 성적 수치심을 유발하는 영상을 착취해 유포하겠다고 협박하거나, 딥페이크 기술을 이용해 만든 ‘가짜 영상’ 등으로 디지털 성범죄 피해를 입은 사람이 지난 해 12월 말 기준으로 처음 1만명을 넘은 것으로 집계됐다. 정부가 2018년부터 디지털 성범죄 피해자를 집계한 이후 최대 규모다.

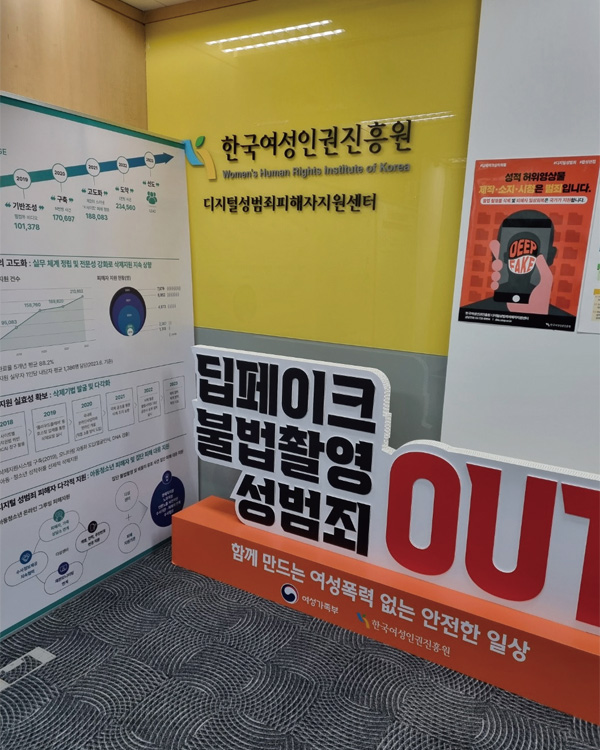

정부는 2018년 4월, 디지털 성범죄 피해 확산을 방지하기 위해 ‘디지털 성범죄 피해자 지원센터(디성센터)’를 설치했다. 개소 당시 1315명이었던 피해자는 6년 새 9배 늘어 1만305명에 달했다.

(출처: 여성가족부 산하 한국여성인권진홍원 디지털성범죄피해자지원센터(디성센터). 2024년 12월말 기준.)

최근 주목되는 점은 ‘합성·편집’으로 인한 디지털 성범죄 피해가 급증했다는 점이다. 피해자들이 가장 많이 호소하는 피해 유형(중복선택)은 ‘유포불안(25.9%)’과 ‘불법촬영(24.9%)’이지만, 가파르게 증가하고 있는 유형은 ‘합성·편집’이다.

최근 주목되는 점은 ‘합성·편집’으로 인한 디지털 성범죄 피해가 급증했다는 점이다. 피해자들이 가장 많이 호소하는 피해 유형(중복선택)은 ‘유포불안(25.9%)’과 ‘불법촬영(24.9%)’이지만, 가파르게 증가하고 있는 유형은 ‘합성·편집’이다.

영상물이 생성된 유형으로 접근했을 때, ‘불법촬영’ 피해 건수가 6년 사이 6배 증가했다면 ‘합성·편집’ 피해 건수는 20배(69건→1384건) 폭증했다. 전체 비중에서는 8.2%를 차지하지만, 디지털 환경 변화와 딥페이크 기술 확산, 생성형 AI의 등장으로 향후 피해는 더욱 다양한 양상으로 늘어날 것으로 보인다.

(출처: 여성가족부 산하 한국여성인권진홍원 디지털성범죄피해자지원센터(디성센터). 2024년 12월말 기준.)

피해자 10명 중 7~8명은 ‘여성’, 절반은 10~20대…불안·공포 속 ‘온라인 그루밍’

문제는 이러한 디지털 성범죄 피해는 항상 여성에 집중해 발생한다는 점이다. ‘N번방’ 사건 이후 낮은 성인지 감수성과 부족한 디지털 윤리 교육 등을 강화해야 한다는 지적이 나왔지만, 여전히 우리 사회 곳곳에서는 여성의 신체와 사생활을 성적인 대상으로 소비하고 있다. 온라인에서 성적 침해를 경험한 여성의 74% 이상은 ‘불쾌하다’고 답한 반면 남성의 48%는 ‘별일 아니라고 생각했다’고 답한 설문 조사(2021년, 서울시여성가족재단)를 보면 성인지에 대한 남녀 차이를 확인할 수 있다. 문제 의식의 결핍, 여성에 대한 성적 대상화와 혐오를 멈추지 않는 분위기 속에서 여성을 겨냥한 디지털 성범죄는 계속 증가할 수밖에 없다.

서울 디지털 성범죄 안심지원센터(이하, 디성센터)에서 지난 2022년 3월부터 2024년 3월까지 2년간 피해 지원 사례를 분석한 결과, 피해자의 86%가 여성이었다. 디성센터에서도 2023년 기준, 여성 피해자는 75%에 달했다. 이중 10~20대가 55.4%를 차지했다. 익명성과 높은 보안성을 악용하는 가해자들이 여성과 청소년을 ‘온라인 그루밍(길들이기)’ 등으로 온라인 공간을 악용하고 있다는 분석이 나온다. 상대방과 친밀감을 쌓은 후 성적 사진과 영상을 보내게 하고, 이에 응한 피해자에게 유포협박을 하면서 더 많은 영상물을 요구하는 형태다. 불안과 공포를 느끼는 피해자들을 신속하고 즉각적으로 구제해 줄 수 있는 방법은 ‘영상 삭제’다.

지워도 독버섯처럼 생겨나…예방 놓쳤다면 피해 인지 즉시 ‘신고’해야

여성가족부 산하 디성센터에서는 각종 성범죄 피해 영상물을 삭제한다. 지워도 지워도 독버섯처럼 퍼져나간다는 게 이곳에서 근무하는 이들의 공통된 목소리다. 매년 삭제 피해 영상물은 증가해, 개소 당시 2만8879건에서 지난해 30만237건으로 10배 넘게 늘었다. 지금까지 삭제한 누적 불법 영상물 건수는 총 120만 건(121만1797건)이 넘는다. 지난 해 기준, 하루 평균 822.5개씩 지운 셈이다.

디지털 성범죄 피해물이라고 하면 화장실, 탈의실 등에 초소형 카메라를 설치해 신체를 불법 촬영한 영상이나 연인과 찍은 촬영물이 본인도 모르게 유포된 영상 등을 주로 떠올리지만, 최근에는 성적 불쾌감을 주는 영상에 피해자 얼굴을 합성·편집해 만든 딥페이크 피해도 크게 늘고 있다고 한다. 예전에는 합성된 영상이 조악해 ‘가짜’라는 게 육안으로 곧장 식별됐지만, AI기술이 발달할수록 합성·편집된 영상이 실제 상황처럼 보여져 피해자의 고통이 더욱 크다는 설명이다.

누군가의 ‘잊힐 권리’를 위해 매일 지우고 또 지우지만, 매년 삭제하지 못한 영상은 25%가량 된다고 한다. 대부분 해외에 서버를 둔 경우다. 국제협력을 통해 일괄삭제할 수 있도록 하고, 부처 간 공조해 수사·법률·의료를 연계해 지원하고 있지만, 무엇보다 우선시 돼야할 점은 ‘예방’이라고 입을 모은다. 여성 혐오와 젠더 갈라치기를 멈추고 결핍된 성인지 감수성을 회복하는 일이 절실하다는 설명이다. 딥페이크로 대표되는 AI기술이 발달함에 따라 디지털 윤리 교육이 더욱 강화돼야 함은 물론이다.

이미 디지털 성범죄 피해를 봤거나 상황 판단이 어렵다면, 이때에는 즉시 신고해야 더 큰 피해를 막을 수 있다.

‘이런 사진을 건네 줘도 되나’, ‘지금 내가 요구 받는 게 디지털 성범죄인가’라는 의심이 들 때가 영상이 유포되기 전 손쓸 수 있는 ‘마지막 골든타임’이다.

글 | 오주연(아시아경제신문 기자)

페이스북 1

페이스북 1 트위터 2

트위터 2 카카오톡 3

카카오톡 3 카카오스토리

카카오스토리 네이버블로그 4

네이버블로그 4  밴드 5

밴드 5

해당호 목록

해당호 목록